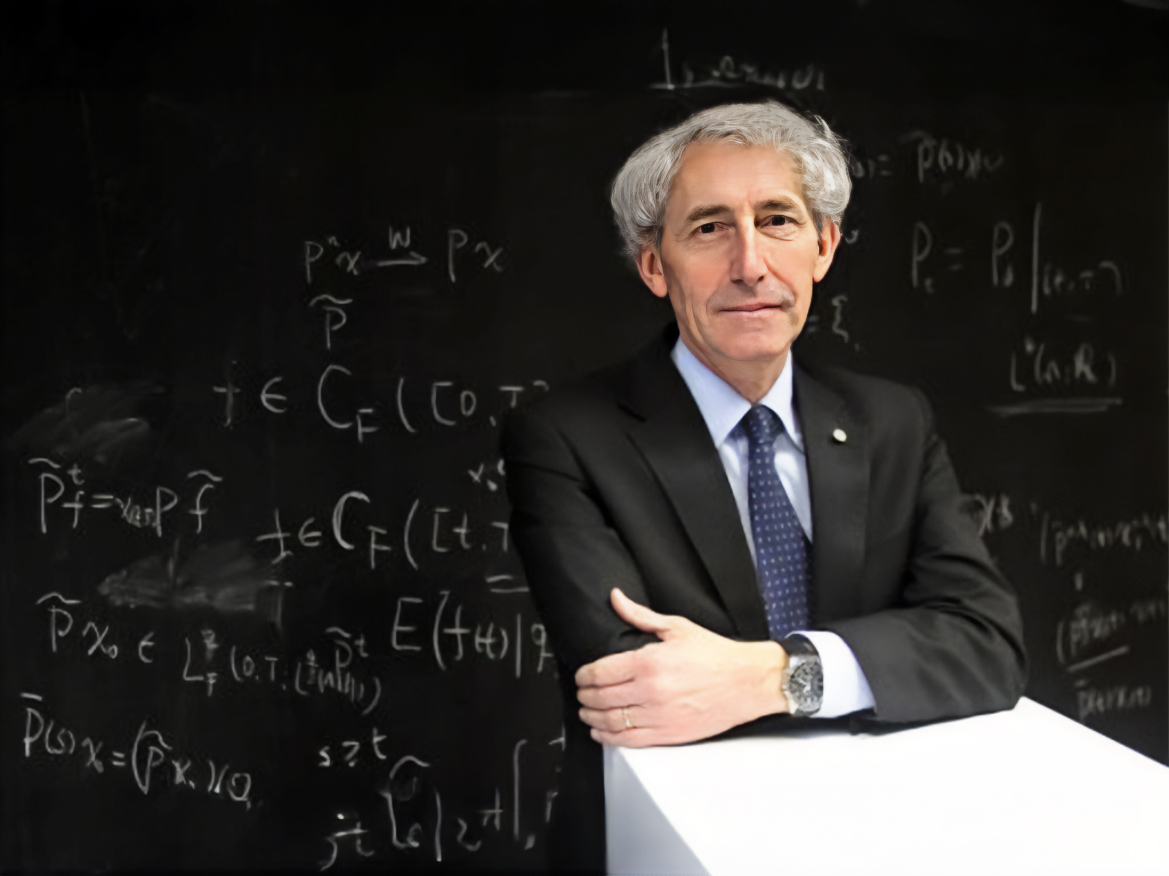

Quella che utilizziamo oggi non è un’intelligenza artificiale che pensa, ma una AI ristretta: sistemi matematici addestrati per eseguire compiti specifici, non per comprendere il mondo. Non lo diciamo noi, lo afferma Alfio Quarteroni, eminente matematico italiano di fama internazionale, in un'intervista live in occasione del Wired Next Fest Trentino (https://www.youtube.com/watch?v=0F5dwp8qv9k).

Quarteroni sosriene che l’AI è potente perché calcola, riconosce pattern e ottimizza decisioni a una velocità inumana, non perché “capisce” ciò che stia facendo. Secondo lo studioso, confondere il calcolo con la comprensione è l’errore più diffuso e più pericoloso nel dibattito pubblico sull’intelligenza artificiale perché da questo bias nascono aspettative sbagliate, paure amplificate e narrazioni fuorvianti.

Per usare davvero l’AI come leva di progresso, il primo passo non è idolatrarla né temerla, ma capire esattamente cos’è e cosa non è.

Il matematico distingue innanzitutto tre tipi di intelligenza artificiale.

-

La prima è l’AI ristretta, l’unica oggi realmente esistente: sistemi progettati per svolgere compiti specifici, come la guida autonoma, l’analisi di immagini mediche, l’ottimizzazione logistica o il dialogo uomo-macchina. Sono tecnologie estremamente efficienti, ma incapaci di uscire dal perimetro per cui sono state addestrate. Non comprendono ciò che fanno: eseguono.

-

Il secondo livello è l’AI generale (AGI), una forma di intelligenza artificiale capace, almeno in teoria, di replicare l’intelligenza umana in tutte le sue dimensioni: ragionamento astratto, creatività, emozioni, comprensione profonda del contesto. Ad oggi, l’AGI non esiste e non esistono certezze sui tempi della sua eventuale realizzazione.

-

Infine, la super intelligenza, un’AI che supererebbe le capacità cognitive umane e che, proprio per questo, viene spesso associata a rischi sistemici e interrogativi etici profondi.

Un concetto chiave per interpretare questi limiti è il paradosso di Moravec: ciò che per gli esseri umani è naturale cioè buon senso, adattamento a situazioni nuove, apprendimento rapido, risulta incredibilmente difficile per le macchine. Viceversa, analizzare milioni di dati o sintetizzare migliaia di pagine di testo è banale per un’AI e impraticabile per una persona. Da qui nasce un principio fondamentale: l’intelligenza artificiale non sostituisce l’uomo, lo affianca. È uno strumento complementare, non un rimpiazzo cognitivo.

Alla base di tutto c’è la matematica. Le reti neurali artificiali non “pensano”: applicano funzioni matematiche non lineari a enormi quantità di dati. Il loro apprendimento ricorda quello di un bambino che impara a parlare ascoltando: esposizione continua, tentativi, correzioni. Ma questa complessità genera uno dei problemi più discussi dell’AI moderna: la black box. Sappiamo come funziona un modello dal punto di vista matematico, ma spesso non siamo in grado di spiegare perché arrivi a una certa decisione. Pretendere algoritmi completamente spiegabili, oggi, è più una richiesta politica che una possibilità tecnica.

Le capacità generative dell’AI dimostrano però che non si tratta solo di copiare o interpolare dati esistenti. Il caso di AlphaFold, che ha portato l’accuratezza nella previsione delle strutture proteiche dal 60% al 92%, mostra come modelli matematici avanzati possano produrre risultati inattesi, sorprendendo persino gli scienziati che li hanno progettati.

Restano aperte sfide cruciali: i bias nei dati, che riflettono differenze culturali e sociali, e soprattutto la sostenibilità ambientale.

I grandi modelli di intelligenza artificiale consumano enormi quantità di energia e acqua. Senza un cambio di paradigma — algoritmi più efficienti, chip ispirati alla biologia, nuove fonti energetiche — questa crescita non è sostenibile.

La conclusione è semplice ma fondamentale: l’intelligenza artificiale non è né buona né cattiva. È uno specchio delle scelte umane. Conoscerne i limiti è il primo passo per usarla davvero come leva di progresso, e non come una scorciatoia tecnologica priva di consapevolezza.

Ecco una serie di domande e risposte estratte dall’intervista di Quarteroni:

Quali tipi di intelligenza artificiale esistono oggi?

Esistono tre principali categorie di intelligenza artificiale: AI ristretta, AI generale (AGI) e super intelligenza. Oggi utilizziamo esclusivamente AI ristrette, progettate per svolgere compiti specifici.

Cos’è l’AI ristretta?

L’AI ristretta è l’intelligenza artificiale che utilizziamo oggi. È guidata da obiettivi specifici ed è progettata per eseguire un singolo compito o una classe limitata di attività, senza capacità di adattamento generale. Esempi di AI ristretta includono:

- sistemi di guida autonoma

- gestione automatizzata dei magazzini

- analisi di immagini mediche

- modelli conversazionali come ChatGPT

Ogni sistema è addestrato per uno scopo preciso e non può uscire dal proprio perimetro operativo.

Cos’è l’Intelligenza Artificiale Generale (AGI)?

L’AI generale (AGI) è un’ipotesi teorica di intelligenza artificiale capace di replicare completamente l’intelligenza umana, inclusi creatività, emozioni, comprensione del contesto e capacità di adattamento.

L’AI generale esiste già?

No. L’AI generale non è attualmente disponibile e non esistono tempistiche certe per il suo sviluppo. Oggi rimane un obiettivo di ricerca, non una tecnologia reale.

Cos’è la super intelligenza artificiale?

La super intelligenza è una forma ipotetica di AI che supererebbe le capacità cognitive dell’essere umano. Proprio per questo viene spesso considerata un potenziale rischio per l’umanità.

Cos’è il paradosso di Moravec?

Il paradosso di Moravec evidenzia che ciò che è facile per gli esseri umani risulta difficile per le macchine, e viceversa. Ad esempio, il buon senso o l’adattamento a nuovi ambienti sono naturali per l’uomo ma complessi per l’AI.

In cosa sono migliori gli esseri umani rispetto all’AI?

Gli esseri umani eccellono in:

- buon senso

- adattabilità a contesti nuovi

- apprendimento rapido e intuitivo

In cosa è più forte l’intelligenza artificiale?

L’AI è particolarmente efficace in:

- analisi rapida di enormi quantità di dati

- sintesi di testi estesi

- individuazione di pattern complessi

Compiti impossibili per un essere umano in tempi brevi.

L’AI deve potrà sostituire l’uomo?

Dipende da noi umani. L’approccio consigliato è quello della complementarietà: l’intelligenza artificiale va utilizzata come strumento di supporto alle capacità umane, non come loro sostituto.

Su cosa si basa matematicamente l’intelligenza artificiale?

L’AI si basa su modelli matematici, in particolare su:

- machine learning, che permette alle macchine di apprendere dai dati

- reti neurali, algoritmi ispirati al funzionamento dei neuroni biologici

Come funzionano le reti neurali?

Le reti neurali ricevono input, elaborano i dati tramite funzioni matematiche e decidono se trasmettere l’informazione ad altri neuroni artificiali. Il loro funzionamento dipende dalle connessioni tra questi nodi.

Come “impara” un’AI?

Il processo di apprendimento è simile a quello di un bambino che impara a parlare: esposizione continua ai dati, tentativi, errori e correzioni, senza una comprensione consapevole del significato.

Cos’è il problema della black box nell’AI?

La black box indica la difficoltà di comprendere come un algoritmo di AI arrivi a una determinata conclusione. Conosciamo il funzionamento matematico, ma spesso non il motivo specifico di una risposta.

Perché gli algoritmi di AI non sono spiegabili?

Le limitazioni attuali includono:

- impossibilità di spiegare il “perché” di una decisione

- mancanza di trasparenza sulla selezione dei dati utilizzati

Per questo motivo, le richieste di algoritmi completamente “spiegabili” sono oggi tecnicamente irrealistiche.

L’AI è davvero creativa?

L’AI generativa dimostra capacità che vanno oltre la semplice interpolazione dei dati. Modelli avanzati possono produrre risultati inattesi grazie a funzioni matematiche non lineari.

Qual è un esempio concreto di capacità generative dell’AI?

AlphaFold ha raggiunto il 92% di accuratezza nella previsione della struttura delle proteine, rispetto al 60% dei metodi precedenti, sorprendendo anche la comunità scientifica.

Quali sono le principali sfide etiche dell’intelligenza artificiale?

Le principali sfide etiche includono:

- manipolazione dei dati di addestramento

- bias culturali e sociali

- differenze nei risultati a seconda del contesto geografico

Perché l’AI produce risultati diversi in culture diverse?

Perché i dati di addestramento riflettono valori, comportamenti e norme locali. Ad esempio, test etici o sistemi di rilevamento della stanchezza funzionano in modo diverso tra Occidente e Asia.

L’intelligenza artificiale è sostenibile dal punto di vista ambientale?

Attualmente no. I modelli di AI generativa richiedono enormi quantità di energia e acqua, rendendo la crescita attuale non sostenibile nel lungo periodo.

Quali soluzioni si stanno sviluppando per ridurre l’impatto ambientale dell’AI?

Le principali soluzioni includono:

- piccoli reattori nucleari

- chip ispirati alla biologia

- algoritmi più efficienti dal punto di vista energetico

Quali sono i rischi futuri legati all’evoluzione dell’AI?

Tra i rischi emergenti ci sono:

- isolamento sociale di persone fragili

- risultati imprevedibili dovuti all’apprendimento autonomo

Un comportamento simile, in fondo, a quello dell’intelligenza umana.

Cosa dovremmo fare oggi per usare meglio l’intelligenza artificiale?

Le azioni principali sono:

- investire in algoritmi più efficienti

- sviluppare framework etici per l’addestramento

- promuovere l’educazione all’uso consapevole dell’AI